慶應義塾大学 栗原 聡 氏

「人工知能」と「自律性」

「人と共生できるAI」の研究を進める栗原聡氏にこれまでのキャリア、そして、AIの果たす役割について伺いました。インタビュアーは日本能率協会、小関俊洋です。(以下敬称略)

「心の社会」が研究のきっかけ

――― 栗原先生のキャリアやお立場についてお話しいただけますか?

大学を卒業して、NTT基礎研究所に入社したのですが、その頃から私の研究テーマは変わっていません。人間が考えたり器用に行動できる原理、その仕組みを解き明かしたいと思って、ずっと研究をしてきました。まず何を研究するかと考えた時に、最初に考えたのが当たり前ですが「脳」を参考にすることです。

マルチエージェントという言葉をご存知でしょうか。脳は外から見ると、一つの塊に見えますが、実際はそうではありません。大脳や小脳、扁桃体など複数のパーツから出来ており、その一つ一つのパーツも膨大な数の神経細胞の集合体です。脳は、複数のモジュールが連携し協調することで、知能を生み出しているのです。

マーヴィン・ミンスキーという、人工知能研究を開拓された偉大な先生が執筆された「心の社会」という本があり、日本語訳を安西祐一郎先生がされていますが、その本に大きな刺激を受けました。我々の心は複数の小さな心から出来ており、それらが社会を構成し、お互いに連携し合うことで、小さな心達の社会システムとして全体としての心が出来ている、という考え方であり、それはまさにマルチエージェントと呼ばれる研究分野の考えそのものです。難しい問題も、1つの人工知能では解くことができなくても、複数の人工知能がお互いに協力することで解けるのではないか? その際、どのように協力させればよいのか? といったところに興味を持ち、研究を進めました。

例えば、それぞれ自律的に動作する人工知能が100体あるとして、その100体がお互いに協調する場合、どのような協調の仕方が考えられるでしょうか。100体の中に親玉的な人工知能が一人いて、残り99体に指令を出す方法もあるでしょうし、親玉は存在せず、全員の合意ができるまでひたすら各自が周りの人工知能達と議論する方法もあります。ここで、お互いに連携する人工知能同士を線で結ぶと、協調の仕方をネットワークとして可視化できます。そこで、現在の研究テーマの1つとして、効果的な協調を実現するための協調ネットワーク形態について研究をしています。「人工知能を作るためにはどのようなパーツが必要なのか」というところから研究を進めて、今ではパーツ同士の関係にも大いに興味があります。

今年の3月までは国立大学である電気通信大学に在籍していましたが、4月から慶應義塾大学理工学部に転籍しました。電気通信大学では、人工知能先端研究センターの設立にも参加しました。初代センター長として、在籍していた人工知能研究に関わっておられる先生達と一緒に立ち上げたのです。

「人工知能」は「人工知能」なのか?

――― AIやロボットに注目が集まっています。現在の状況をどのように思いますか?

現在の人工知能ブームは実は3度目でして、新聞でも毎日、人工知能に関するキーワードが話題になっています。しかし、「人工知能」という表記がいろいろな誤解や行き過ぎた思い込みを生み出してしまっているではないかと思います。人工的に知能をつくるという意味ですから、人工的につくる以上はつくる対象がちゃんとわかっていなければつくることはできませんよね。

しかし、「知能」という言葉は漠然として、いろんな意味にとれてしまいます。計算ができる、読める、そういった具体的な能力を指して「知能」と言うこともあれば、自然界という厳しい世界で生き抜くことこそが「知能」だと考えることもできる。無論、犬・猫・昆虫なども「知能」を持っていると定義することもできます。幅広い意味を持たせることができるので、いろんな捉え方ができてしまいます。

その意味では、新聞やメディアで飛び交う「人工知能」という単語は、「人工知能」ではなく、「知的IT技術」や「高度IT技術」と呼ぶ方が適切その実体に合っていると思います。これまでの情報技術がさらに進化したものであると考えても問題がないからです。「人工知能」を「知的IT技術」に読み替えた時に、文脈がおかしくなるものは何一つないのではないでしょうか。「IT技術の延長だ」と言った方がわかりやすし、誤解を生まないと思います。

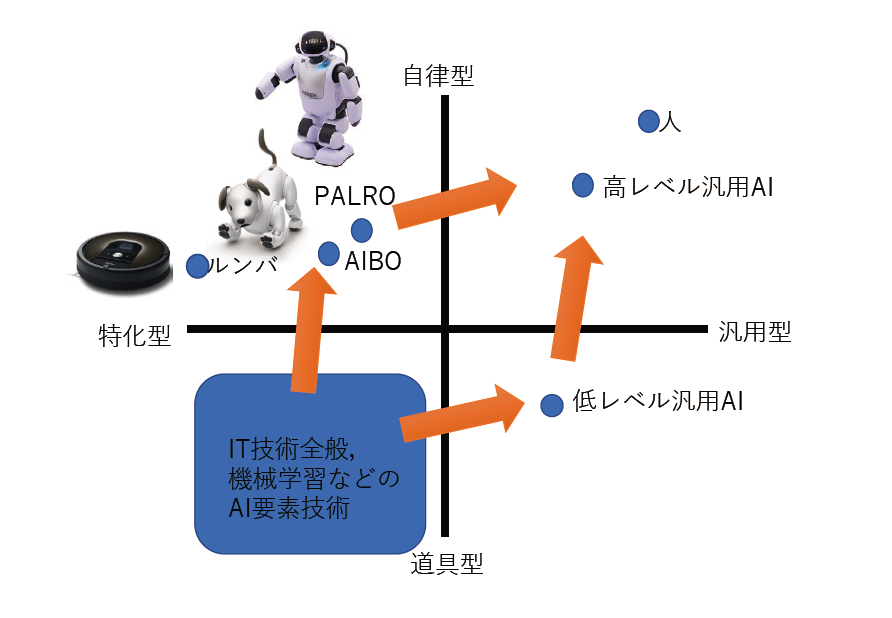

では、「IT技術」と本当の意味での「人工知能」では何が違うのか。その代表が「自律性」です。「能動性」と言ってもいいでしょう。環境を生き抜く能力こそが知能であるという定義において、そのような知能は受動的な存在ではあり得ません。「道具」ではなくて、自らが生き抜くために環境に適応していく、自らが積極的に動く存在なんです。元来、「知能」にはそういった意味が含まれていると思います。

これに対し、現在の人工知能技術は全て我々にとっての「道具」ですよね。要素技術なんです。例えば、人の顔を認識してくれる技術、これも「道具」です。計算ができる、質問に答えることができる、適切な情報を収集できる、これらすべては「道具としての技術」です。決して「道具」を否定しているわけではありません。科学技術とはもともと私たちの能力を拡張することが目的であり、そのような「道具」を生み出すことこそが目的だからです。

しかし、本来の「人工知能」は、それとは異なります。自らが能動的に動くための目的を持つのです。動作を生み出すための根元的な動機がそこにはあります。そのような自律性を持つものこそ「人工知能」と呼ぶべきだと思うのです。

――― 自律性を持った人工知能の研究の状況はどのようなものなのでしょうか?

これから重要になるキーワードと言っておきながら、実は自律とか自律分散システムといった能動的なシステム構築に関する研究は20、30年前からずっと研究されているのです。研究といってもいろいろな取り組み方があり、特に基礎研究などは、新しい知見が得られることと、その知見を具体的に使って役立てることとは話が別なのです。ディープラーニングにしても、基本的な技術が確立されたのは10年以上も前になります。では、なぜ、今盛り上がっているかというと、10数年前はディープラーニングの能力を引き出すための基盤が整ってなかったからです。10数年前は、まだ学習のための大量のデータを容易に使うこともできなかったし、現在のような高性能なコンピュータもありませんでした。現在だからこそその状況が整い、具体的に実装し動かすことができるから盛り上がっているわけです。

先ほど複数の人工知能が協調するマルチエージェントの話をしました。協調するためには具体的に人工知能同士が頻繁に通信する必要があります。例えば、何千万、何億という人工知能が通信しようとすると、そのような通信手段は以前はありませんでした。今は通信インフラがかなり整備されてきています。コンピュータも高速かつ小型化し、何よりディープラーニングのおかげで画像認識など機械学習の能力が格段に向上しました。ようやく自律分散システムを現実に実装できる下地ができてきた。それが今なんです。

人工知能の実現に対する課題とは?

――― 自律型の人工知能を実現するための課題とはなんでしょうか?

自律型をつくる、という意味ではそんなに難しいわけでもありません。「どのように人間とインタラクションするか」です。SiriやGoogleスピーカーなどのAIスピーカーは「明日の天気は?」と聞けば音声で答えてくれます。問い合わせることに対しては答えてくれますが、雑談にはなかなか答えてくれません。もっと言えば、質問者である私自身のことを踏まえて、答えてくれているわけではありません。

AIスピーカーは各社が提供しているサーバーとつながっていて、そこに蓄積されている知識量は人間一人が及ばないほど膨大でしょう。知識の量で言えば、圧倒的に人間を超えている。しかし、私たちのような人間らしい会話はなかなかできません。AIスピーカーは話す相手についての知識がないからです。人同士であれば、知り合い同士であれば互いについての知識を持っているし、我々は常識や暗黙知といった普段意識しないものの皆が共通に持つ知識も利用して会話をしているのです。日本だと「今日は暑いですね」と天気の話題から入ることが多いですが、暑いことを伝えることが目的ではないですよね。相手と共通の話題でその場を和やかにしたいとか、緊張をほぐしたいということがそもそもの目的なわけです。お互いの背景がわかっているから成り立つ会話なのです。現在のAIスピーカーにはそのような背景知識がないわけで、であるならば、相手のことを知る必要が出てくるわけです。

富士ソフトの身長40㎝くらいの人型ロボットpalroがとても面白い。介護施設などで高齢者の前で体操を指導をしたりするロボットなのですが、palroは高度な画像認識能力を持っているので、おじいちゃんおばあちゃんの顔を覚えることができるし、その時々の会話も覚えることができる。すると、朝、おはようとおばあちゃんがpalroに話しかけると、ただ「おはよう」と言い返すだけでなく、「昨日は〇〇の話をしたね」といった言い返しができるわけです。そうなると、おばあちゃんは嬉しいわけです。なにせpalroが自分のことを分かって話してくれると思うからです。このようなちょっとしたことでロボットと人間の関係は変わる。まだ、現状ではプログラミングされた世界かもしれませんが、もっと能動的になれば、人間社会に溶け込んでいくと思います。

その時々の状況に応じて、今、何をしなければいけないのかを予測する。そして、次に重要なのはタイミングです。我々人間にとって、時間軸は非常に重要ですが、今のコンピュータには時間軸は関係ありません。いかに早く計算するかしかありません。しかし、私たちの場合は会話をしていて、少し早くても遅れても違和感を感じてしまいます。人間は時間軸に生きている生き物なんですね。間合い、すなわちタイミングがぴったりでないと、うまくコミュニケーションできないのです。そのためにも人工知能にとってセンシングは重要です。

IoT技術の進歩でいろんなことができるようになってきました。ロボットが高速にいろんな情報を入力して、その人の行動を予測し、ベストなタイミングで動き、その人の状況もわかるようになる。それを可能にする技術が揃ってきています。あとは、どのように行動するのかだけです。基本的な要素が揃っているとすれば、最初の段階では、それほどたくさんの知識がなくてもいいのかもしれません。

幼稚園児の知識量や語彙数は極めて少ない。でも、親と感情豊かな会話が当たり前のように成立している。知識の量ではなくて、持っている知識をどう使うかなんです。スターウォーズのR2D2は言葉は喋れません。単なる音と仕草のみで、もちろん映画という作られた表現ではありますが、我々はR2D2の感情を充分に理解することができますよね。つまりは、人との息の合ったやりとりをする、ということにおいては、まずは喋らなくてもいいかもしれない。そういったところから、人とやりとりをするロボットの技術を固めていき、少しずつレベルを上げればいいのだと思います。

――― ロボットに仕事を奪われるという議論がありますが?

人工知能・ロボット技術がこのまま進化して社会進出が進めば、我々の仕事のやり方も当然変わると思いますが、現在のこの議論においては誤解もあるように思います。例えば、もはや計算する時に電卓を使わない人はいないでしょう。でも電卓に計算する仕事を奪われたという人はいない。難しい税理計算も簡単にやってくれるものがあれば当然使いますよね。人工知能やコンピュータの何が凄いかというと、その正確さと大量のデータを扱い、継続して計算し続けることができるということです。コンピュータに得意なタスクはコンピュータに任せればいいのです。そのような性質の職場への導入はどんどん加速すると思います。それは、自動車工場が自動ロボット化したことと同じ流れです。

一方、人間は創造性や多様なものの見方が得意で、人工知能は逆にこういったことは苦手です。人工知能が苦手な部分はやはり人の出番です。そして、新しい技術やインフラが登場すれは、それに呼応するように新しい職業もどんどん生まれてくるはずです。ロボットに職を奪われると悲観する必要はないと思います。人間の強みを生かして、職業や働き方を変えていく。例えば、芸術の分野では、人が創造した作品だからこそ価値があります。そして、その価値は人間にしか理解できないのです。

関連記事一覧

最新情報

最新情報